ComfyUI.Tokyo

複数条件の場合はキーワードの間にスペースを入れてください。例 ksampler controlnet

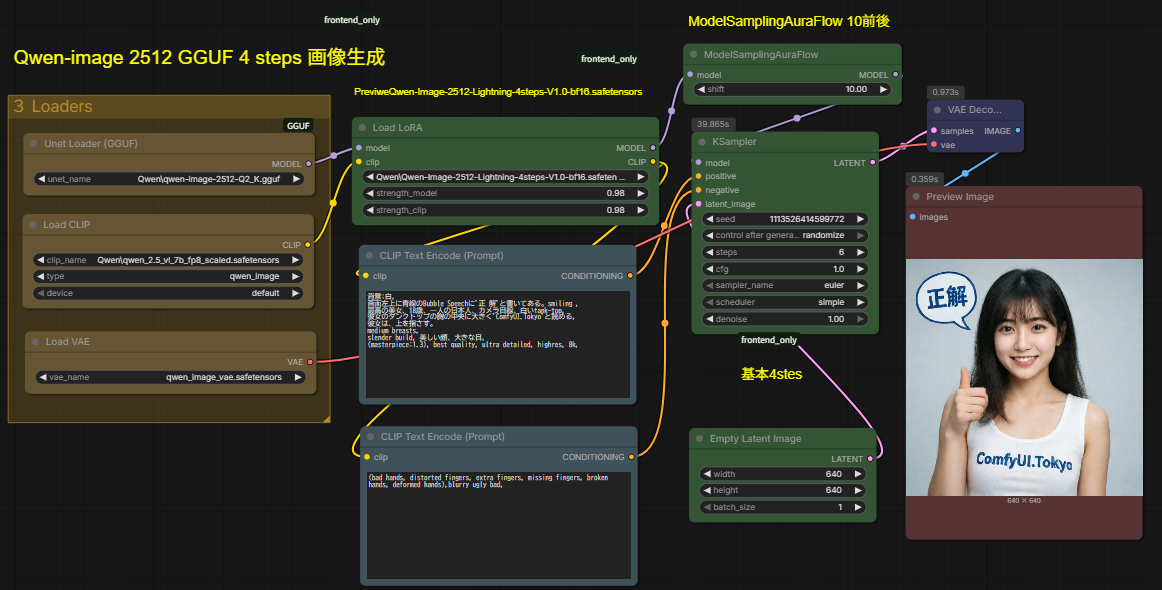

Qwen_Image_ 2512_GGUF_ 4_Steps

アリババ(Alibaba)がリリースした最新の画像生成モデル「Qwen-Image-2512」をComfyUIで扱うための、主要なコンポーネントについての解説です。

これらは、高品質な画像を「速く」「省メモリで」「正確に」生成するために組み合わせて使われる要素です。

1. ComfyUI Qwen-Image-2512 GGUF版

Qwen-Image-2512は、2024年12月末に公開されたQwen-Imageシリーズの最新版です。従来よりも「人物のリアルさ」「自然な質感(毛並みや風景)」「画像内の文字の正確さ」が大幅に向上しています。

- GGUF版とは: 本来、この巨大なモデルを動かすには膨大なビデオメモリ(VRAM)が必要ですが、GGUF形式はモデルを「量子化(軽量化)」したものです。

- メリット: VRAMが少ないPCや、Apple Silicon(Mac)などの環境でも、メインメモリを併用しながら高速・省電力で動作させることが可能になります。

- 使い方: `ComfyUI-GGUF` というカスタムノードを導入し、`Unet Loader (GGUF)` ノードでモデルを読み込みます。

2. Qwen-Image-2512-Lightning-4steps-V1.0-bf16.safetensors

これは、生成時間を劇的に短縮するための「Lightning(高速化)モデル」です。

- 4stepsの意味: 通常、AI画像生成には20〜50回ほどの計算(ステップ)が必要ですが、このモデル(またはLoRA)を使用すると、わずか 4ステップ で高品質な画像が完成します。

- bf16.safetensors: 「bfloat16」という精度形式で保存されたファイルです。従来のfp16よりも計算の安定性が高く、特に最新のGPU(RTX 30/40シリーズなど)で効率よく動作します。

- 役割: 生成を爆速にするための「ブースター」のような存在だと考えてください。

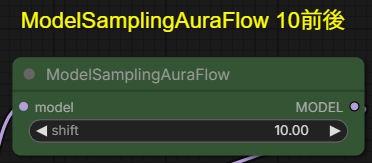

3. ModelSamplingAuraFlow

これはComfyUI内のノードの名前で、モデルの計算方法(サンプリング)を微調整するための設定項目です。

- 役割: 元々は「AuraFlow」という別のモデル用に開発された技術ですが、Qwen-Imageのような最新モデルで「構図の安定」や「ディテールの密度」を制御するために流用されます。

- 具体的な効果: サンプリング時の「タイムシフト(時間の進み方)」を調整します。

- 高い値: 全体の構成(構図)をより丁寧に作り込みます。

- 低い値: 細部の書き込み(テクスチャ)に注力します。

Qwen-Imageの公式ワークフローでは、このノードを挟むことで生成される画像のクオリティを最適化しています。

まとめ:どう組み合わせるのか?

基本的には以下のような流れでワークフローを組みます。

- GGUF版モデルをロードしてメモリ消費を抑える。

- ModelSamplingAuraFlow を繋いで、Qwenモデルに最適な計算スケジュールを設定する。

- Lightningモデル(4steps) の設定を適用し、サンプラーのステップ数を「4」にして高速生成を行う。

ModelSamplingAuraFlowは、なぜ shift を上げると「肌がきれいに」描けるのか?

Qwen-Image(特にFluxやAuraFlow系の構造を持つ最新モデル)において、ModelSamplingAuraFlowの `shift` 値は画像の破綻を防ぐための「命綱」のような役割を果たします。

なぜデフォルトの `3` ではダメで、`10` 近くまで上げる必要があったのか、その理由を技術的に紐解くとスッキリするかも。

`ModelSamplingAuraFlow`(Time Shift)というノードは、生成プロセスにおける「ノイズ除去のスケジュール」をコントロールしています。

- デフォルト(3付近)の場合:

AIは早い段階から「細かいディテール(質感や小さなパーツ)」を描こうとします。しかし、VRAMが少ない環境や軽量化されたGGUFモデルでは、全体の構造が固まる前に細部を描き込もうとして、結果的にグチャグチャな画像(ノイズの塊や色が混ざった状態)になりやすいのです。 - 値を上げる(10付近)の場合:

スケジュールが「大枠優先」にシフトします。生成の初期段階で「どこに何があるか」という構図と色の塊をしっかり確定させる時間を長く取ります。これにより、VRAM 6GBという厳しい条件下でも、AIが迷子にならずに安定した絵作りができるようになります。

ComfyUIにおけるModelSamplingAuraFlowの設定は、単なる「画質の好み」だけでなく、「手持ちのハードウェア(VRAM)とモデルの重さ(量子化サイズ)のギャップを埋める調整弁」として非常に機能的です。

特にQ2~Q4という極限まで圧縮されたモデルを使っている場合、AIは常に「どの情報を捨てて、どの情報を補完するか」を迷っています。

そこで

以上が、shift を 10 に上げることで「人肌がきれいになる」最大の理由です。

workflow

+プロンプト

- 背景:白, 画面左上に青線のBubble Speechに'正 解'と書いてある。smiling , 最高の美女、18歳、一人の日本人、カメラ目線、白いtank-top, 彼女のタンクトップの胸の中央に大きく'ComfyUI.Tokyo'と読める, 彼女は、上を指さす。 medium breasts, slender build, 美しい顔、大きな目, (masterpiece:1.3), best quality, ultra detailed, highres, 8k,

-プロンプト

- (bad hands, distorted fingers, extra fingers, missing fingers, broken hands, deformed hands),blurry ugly bad,

結果の一例

z-image-turboが事務的画像でしたが、flux SRPOの肌感をqwenに取り入れたような感じです。

髪ですね。髪の繊細さをよく表すようになっています。

ところがこの繊細さが機械系では悪さをします。

そんなときは、qwen-imageは、あきらめて、機械系に強いz-imageにしましょう。